|

做网站优化,首先就必须知道爬虫爬取网站的要求,当然这就是传说中的robots文件,见识过众多网站,但是你知道我们自己关注的网站robots文件都是怎样写的吗?

查了几个网站的情况,有淘宝的、京东的,还有比较奇怪的网站,还有有些人建站写robots文件的奇葩写法。

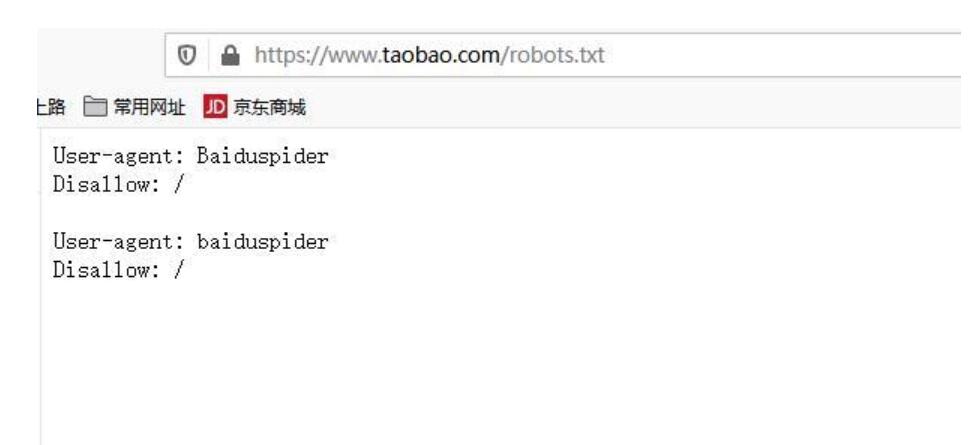

1、淘宝的:

淘宝的

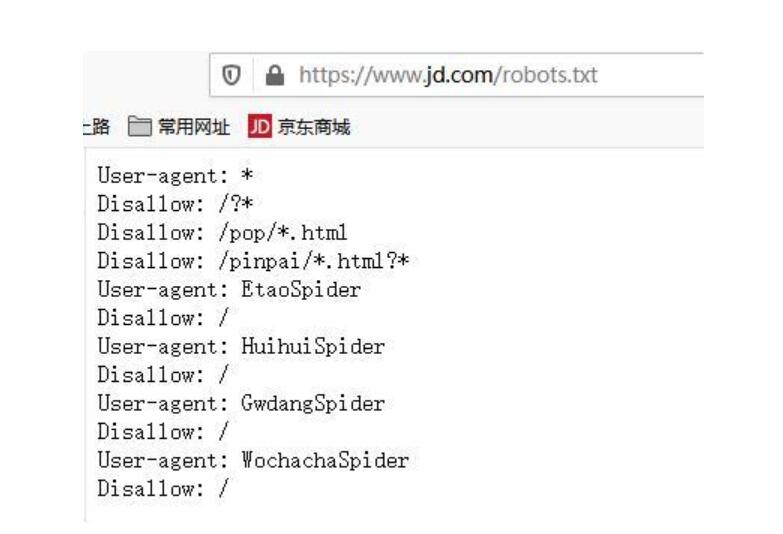

2、京东

京东

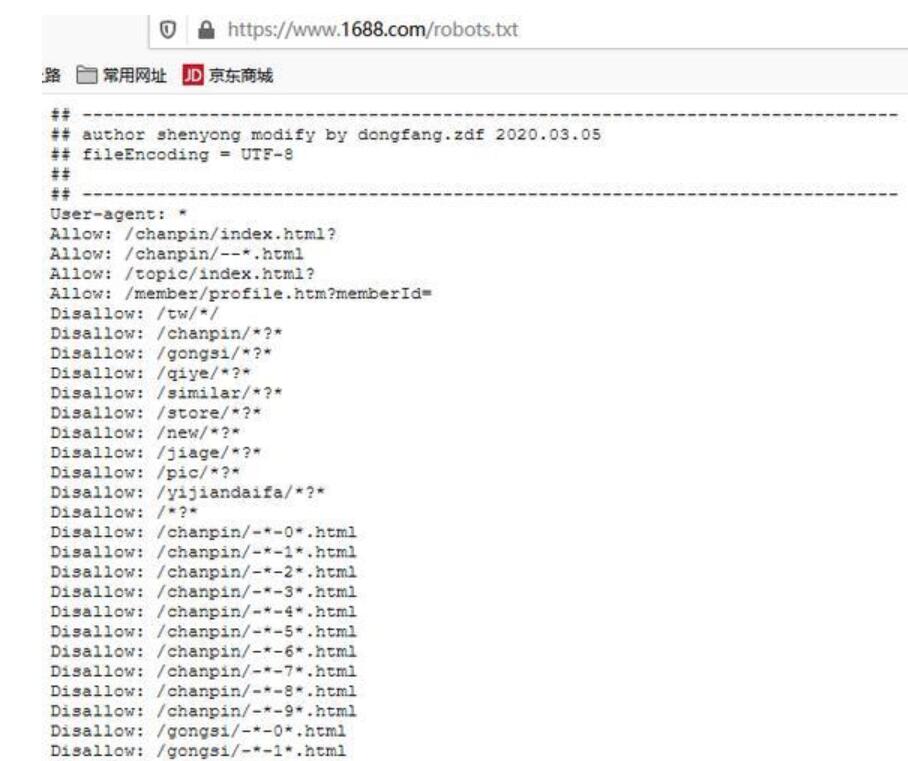

3、1688(有点长,只截取了一部分)

1688

4、奇葩的写法

你知道 YandexBot、DotBot、bingbot、SemrushBot、SemrushBot-SA、AhrefsBot、YandexBot、DotBot、SemrushBot、SemrushBot-SA、AhrefsBot这些屏蔽的内容是什么吗?查了那么多的网站,的确找不到这些一段段的英文是什么意思。还有一些下面添加了sitemap的,更不明白了吧!

关于robots文件的写法,百度资源平台一直都有告诉我们。

robots.txt文件的格式

robots文件往往放置于根目录下,包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示:

“<field>:<optional space><value><optionalspace>”

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow和Allow行,详细情况如下:

User-agent:该项的值用于描述搜索引擎robot的名字。在”robots.txt”文件中,如果有多条User-agent记录说明有多个robot会受到”robots.txt”的限制,对该文件来说,至少要有一条User-agent记录。如果该项的值设为*,则对任何robot均有效,在”robots.txt”文件中,”User-agent:*”这样的记录只能有一条。如果在”robots.txt”文件中,加入”User-agent:SomeBot”和若干Disallow、Allow行,那么名为”SomeBot”只受到”User-agent:SomeBot”后面的 Disallow和Allow行的限制。

Disallow:该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被 robot访问。例如”Disallow:/help”禁止robot访问/help.html、/helpabc.html、/help/index.html,而”Disallow:/help/”则允许robot访问/help.html、/helpabc.html,不能访问/help/index.html。”Disallow:”说明允许robot访问该网站的所有url,在”/robots.txt”文件中,至少要有一条Disallow记录。如果”/robots.txt”不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

Allow:该项的值用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头的URL 是允许robot访问的。例如”Allow:/hibAIdu”允许robot访问/hibaidu.htm、/hibaiducom.html、/hibaidu/com.html。一个网站的所有URL默认是Allow的,所以Allow通常与Disallow搭配使用,实现允许访问一部分网页同时禁止访问其它所有URL的功能。

使用”*”and”$”:Baiduspider支持使用通配符”*”和”$”来模糊匹配url。

“*” 匹配0或多个任意字符

“$” 匹配行结束符。

最后需要说明的是:百度会严格遵守robots的相关协议,请注意区分您不想被抓取或收录的目录的大小写,百度会对robots中所写的文件和您不想被抓取和收录的目录做精确匹配,否则robots协议无法生效。

关于robots文件的撰写方法,一般人都是无从下手的,就像小编我一样,但是仔细分开来看,只需要写一个就行,那就是:

user-agent:*

disallow:/

或:

allow:/

一个禁止所有搜索引擎访问,一个是允许所有robots访问,当然为了安全起见,也可以选择国内外的所有搜索 引擎选择性屏蔽。

更多关于互联网的问题,小编这里都有!

|